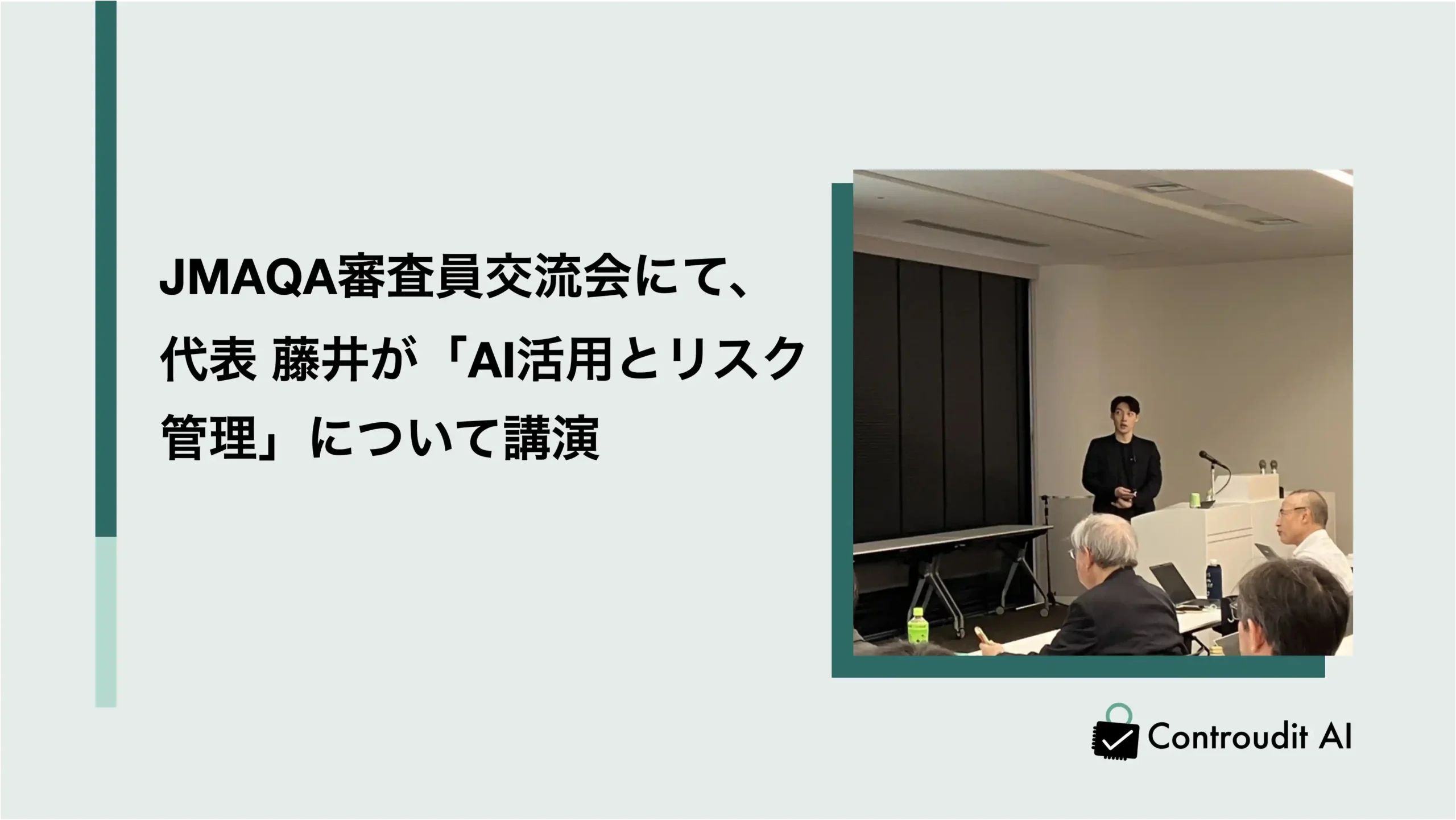

JMAQA審査員交流会にて、弊社代表が講演

AI時代の「攻め」と「守り」を両立する新しいガバナンスの在り方を提言

2025年10月27日、株式会社AI共創総研(旧:株式会社Controudit AI)は、JMAQA(日本能率協会審査登録センター)が主催する審査員交流会において、「AI活用とリスク管理」をテーマに講演を行いました。JMAQAは国内トップクラスの規模を誇るISO認証機関であり、審査の最前線で活躍する専門家が多数参加する場です。今回の講演では、急速に進化するAI技術が企業活動に与える影響を整理し、AI活用のメリットと、それに伴うリスクやガバナンスのあり方について、審査員の皆様に幅広くお伝えしました。

AIがもたらす社会的変化とリスク

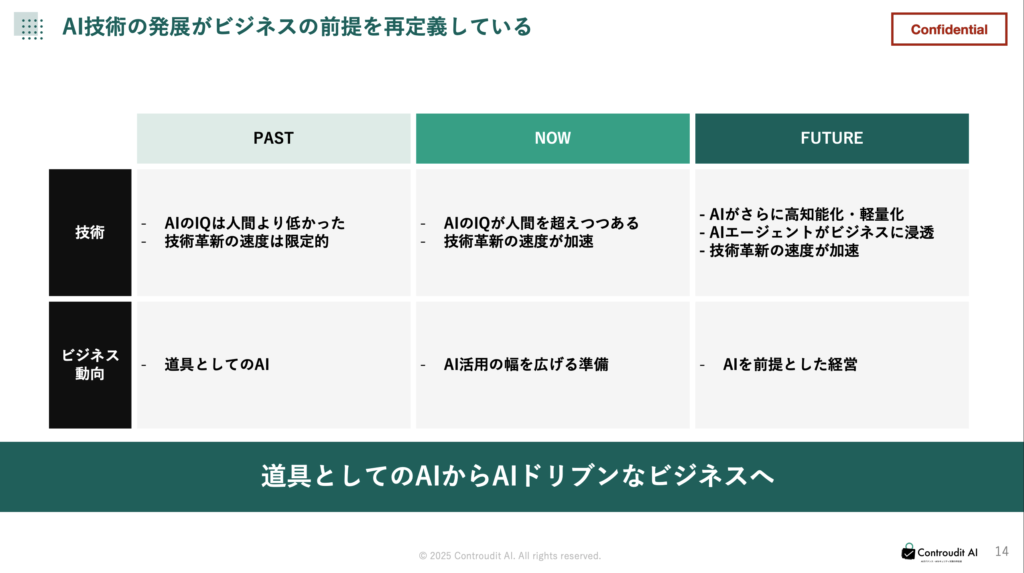

講演の冒頭では、生成AI・大規模言語モデル(LLM)の登場によって、企業活動がどのように変化しているかをご紹介しました。ChatGPTをはじめとする生成AIは、リリースからわずか数か月で世界的に急速に普及し、従来のIT普及曲線を大きく上回るスピードで企業の現場に浸透しています。かつては一部の専門家だけが扱っていたAIが、今ではあらゆる職種が活用できる「業務インフラ」へと変わりつつあります。

AIが価値を生む領域は、文章作成・企画・顧客対応・データ分析・ソフトウェア開発など、知的労働全般に広がっています。例えば、マーケティング資料の下書き作成、FAQの自動生成、UIデザインの自動提案、データレポートの高速生成など、人の作業を補助する領域は急速に拡大しています。

一方で、AIの急速な導入によってリスクも顕在化しています。データ品質の問題、バイアスの混入、説明可能性の欠如、誤情報生成、モデルの安全性、運用プロセスのブラックボックス化など、従来のIT監査では十分に捉えきれない課題が発生しています。講演では、こうしたリスクの代表例を挙げつつ、それぞれのリスクが企業の信用・業務プロセス・安全性にどのような影響を及ぼすのかを整理しました。

AI活用に伴うリスクとガバナンスの必要性

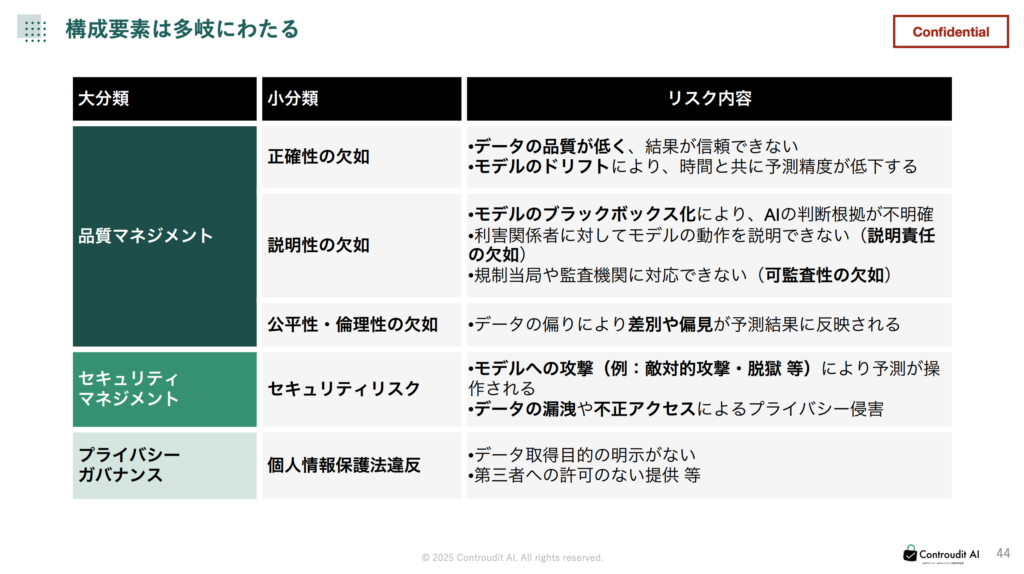

次のセッションでは、AI活用に伴うリスクをどのように適切に管理すべきかを整理しました。資料の中でも「AI活用に伴うリスク」の章を用いながら、次のような論点を共有しました。

- 精度リスク:誤った判断を提示する可能性

- 公平性リスク:特定の属性に対するバイアス

- 説明可能性リスク:出力の根拠が不透明

- セキュリティリスク:プロンプトインジェクション、モデル流出など

- 運用リスク:管理プロセスが属人化しブラックボックス化する

こうしたリスクは「AIだから発生する新しいリスク」ではなく、従来の情報システムリスクがAIの特性によって増幅したものと位置付けるべきであることも強調しました。

また、ISO 42001、NIST AI RMF、EU AI Actなど、国際的に整備されつつある枠組みに触れながら、企業が自社のAI活用方針をどのように決め、どのように運用すべきかについても解説しました。

審査員にとってのAIリスク評価の視点

今回の講演の目的は、審査員の皆様がAIシステムの審査に携わる際、どのような視点を持てばよいかを整理することでした。資料の冒頭で掲げた通り、本講演のゴールは「AI活用の可能性と、それに伴うリスク管理・ガバナンスの論点を俯瞰すること」です。

特に以下の点を重点的にお伝えしました。

- AI活用は“攻め”と“守り”の両方が必要

- AIガバナンスは技術だけでなく、人・プロセス・組織が不可欠

- 審査員は「管理プロセスの設計」「リスクの特定」「統制の妥当性」を確認する役割を担う

- AIは変化が激しいため、アジャイルなモニタリングと改善が前提となる

審査員の皆様からは、AI活用のリスク事例や説明可能性の評価方法などについて多くの質問を頂き、現場での関心の高さを強く感じました。

まとめ

今回のJMAQA審査員交流会での講演は、審査機関の専門家とAIガバナンスの最新動向を共有する大変貴重な機会となりました。企業のAI活用が当たり前になった今、審査員の役割も大きく変わりつつあります。AI共創総研としても、引き続きAI時代に求められるガバナンスの在り方を研究し、社会全体のAI活用の成熟に貢献してまいります。本件に関するお問い合わせは、当社ホームページのお問い合わせ窓口よりお願いいたします。

引き続きご愛顧賜りますようお願い申し上げます。

同じカテゴリーの記事